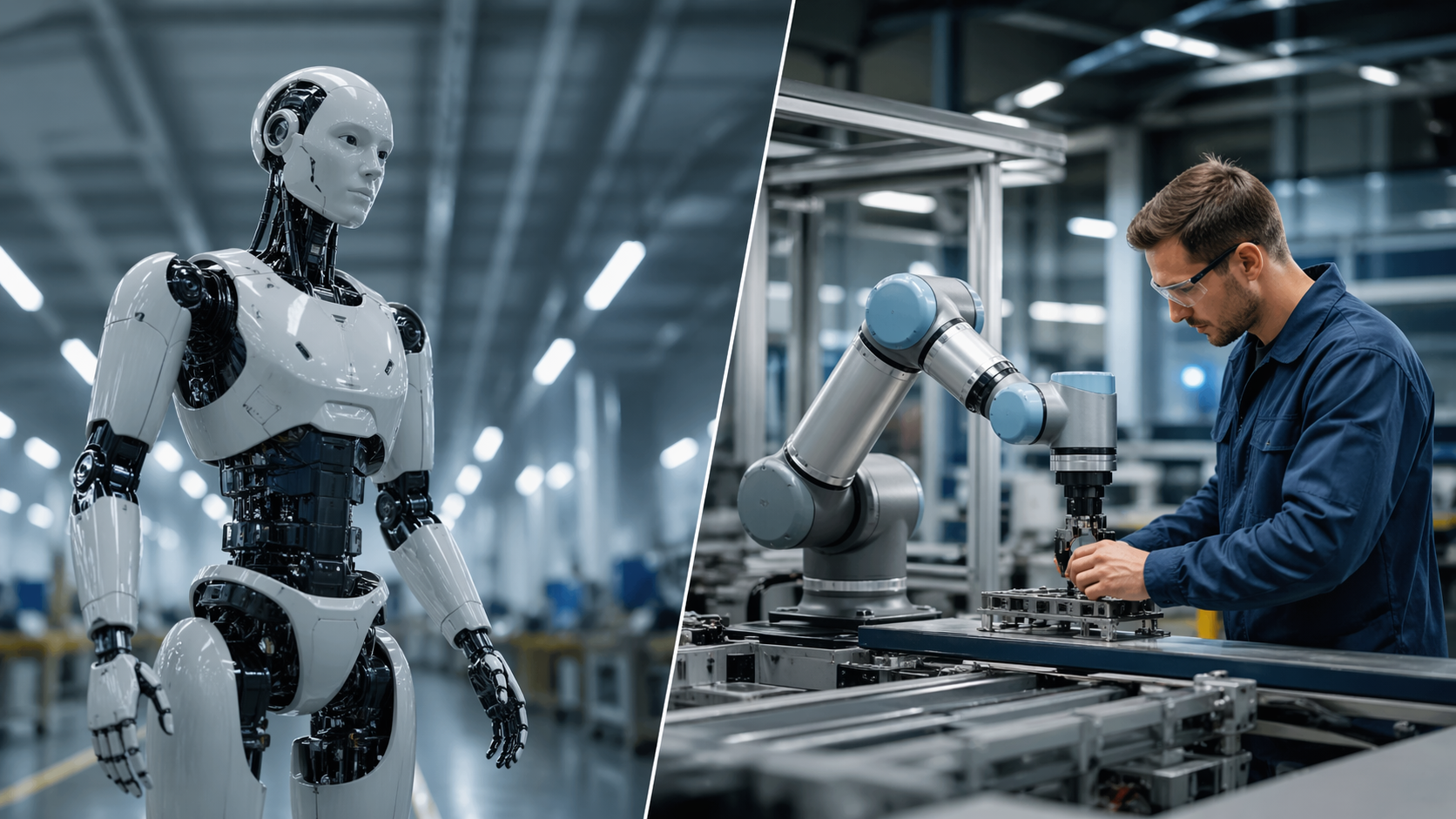

Die AI-Roboter kommen – doch die Welt ist nicht bereit. Genau das zeigt der Blick auf die neuesten humanoiden Entwicklungen: Die Technik macht sichtbare Sprünge, aber Alltag, Vertrauen und Infrastruktur hinken hinterher. In Demos wirken Roboter bereits erstaunlich flüssig, adaptiv und geschickt. Trotzdem bleibt der Abstand zwischen „beeindruckender Vorführung“ und „verlässlicher Helfer im echten Leben“ groß. Denn Wohnungen, Arbeitsplätze und Sicherheitsstandards sind nicht auf Maschinenfehler, KI-Halluzinationen und unvorhersehbares Chaos ausgelegt.

Inhalt

- 1 Das Wichtigste in Kürze

- 2 Sind humanoide Roboter schon bereit für Haushalt und Alltag?

- 3 Google DeepMind zeigt, wie „flüssig“ Robotik werden kann

- 4 Gemini Robotics und „embodied reasoning“ als Schlüssel für humanoide Systeme

- 5 Der neue Hype um Humanoide: Big Tech trifft Start-ups

- 6 Grundsatzfrage: Roboter an unsere Welt anpassen – oder unsere Welt an Roboter?

- 7 Warum Lagerroboter heute gewinnen – und Humanoide kämpfen müssen

- 8 Sprache als Gamechanger – aber Halluzinationen als reales Risiko

- 9 Fazit

Das Wichtigste in Kürze

- Google DeepMind demonstriert mit „Gemini Robotics“ robotische Feinmotorik, die nicht mehr rein starr vorprogrammiert wirkt.

- Die zugrunde liegende Technik soll auch humanoide Roboter antreiben und wird u. a. mit Apptroniks „Apollo“ getestet.

- Humanoide sollen in menschlich gebauten Umgebungen funktionieren, doch das ist schwerer als spezielle Roboterzonen im Lager.

- Sprachmodelle (Gemini, GPT) könnten Bedienung vereinfachen, erhöhen aber auch Risiken durch Fehlinterpretationen.

- Akzeptanz ist fragil: Menschen verzeihen Robotern weniger Fehler als Menschen – Vertrauen kann schon nach einem schweren Patzer kippen.

Sind humanoide Roboter schon bereit für Haushalt und Alltag?

Noch nicht. Die Demos zeigen große Fortschritte bei Greifen und Anpassen, aber reale Haushalte sind chaotisch, voller unvorhersehbarer Situationen und riskant bei Fehlern – besonders, wenn Sprach-KI falsche Anweisungen „halluziniert“ und der Roboter diese physisch umsetzt.

Google DeepMind zeigt, wie „flüssig“ Robotik werden kann

In einem Demonstrationsvideo von Google DeepMind sieht man einen Roboterarm, der Origami faltet, Snacks in Ziploc-Beutel packt und Gegenstände überraschend präzise manipuliert. Entscheidend ist dabei nicht nur die Genauigkeit, sondern die Art der Bewegung. Sie wirkt weniger wie ein starres Skript und mehr wie ein anpassungsfähiger Prozess. Wenn ein Objekt aus der Hand rutscht, korrigiert der Arm schnell und macht weiter. Das signalisiert einen Übergang von „Programm ausführen“ zu „Situation verstehen und reagieren“. Der Kern dahinter ist ein neues Modell namens „Gemini Robotics“, das Google Anfang des Monats vorgestellt hat. Die Demo zeigt zwar vor allem Arme, aber die Technik zielt klar auf den nächsten Schritt: Roboter mit breiterem Körper- und Aktionsspektrum.

Gemini Robotics und „embodied reasoning“ als Schlüssel für humanoide Systeme

Google betont, dass Gemini Robotics sich leicht an unterschiedliche Robotertypen anpassen soll. Das ist wichtig, weil Robotik sonst oft stark auf eine Hardware zugeschnitten ist. Laut Google wird das Modell bereits mit Apptroniks humanoidem Roboter „Apollo“ getestet. Damit wird deutlich: Es geht nicht um einzelne Tricks, sondern um eine Plattformlogik. Carolina Parada, Leiterin des DeepMind-Robotikteams, ordnet das als „embodied reasoning“ ein. Gemeint ist eine verkörperte Form von Denken, die die physische Welt erfassen und angemessen darauf reagieren kann. Genau das fehlt Robotern traditionell: Sie „sehen“ nicht wie wir, sie „verstehen“ nicht wie wir, und sie stolpern über Kleinigkeiten. Wenn aber ein Modell Situationen besser einordnet, wird Robotik im Alltag überhaupt erst realistisch. Trotzdem bleibt offen, ob dieses Verständnis robust genug ist, wenn Bedingungen plötzlich wechseln.

Der neue Hype um Humanoide: Big Tech trifft Start-ups

Die DeepMind-Demo ist Teil einer breiteren Welle. Große Tech-Konzerne wie Google und Meta und Start-ups wie Figure AI und Agility Robotics treiben humanoide Konzepte voran. Vermarktet werden sie als Zukunft für Logistik und Haushaltsarbeiten. Die Faszination ist alt: Kaum eine Sci-Fi-Idee – außer vielleicht fliegende Autos – lockt so stark wie Robothelfer für Geschirr, Wäsche und Routinejobs. Gleichzeitig schwingt immer auch Angst mit, weil Maschinen im Alltag Macht über Räume und Menschen hätten. Jetzt kommt ein neuer Treiber dazu: leistungsfähige KI-Modelle, die Sprache verstehen und generieren. Dadurch wirkt humanoide Robotik plötzlich weniger wie Fernzukunft. Aber die Diskrepanz zwischen Vision und Alltag bleibt groß, und genau deshalb ist „die Welt nicht bereit“.

Grundsatzfrage: Roboter an unsere Welt anpassen – oder unsere Welt an Roboter?

Im Zentrum steht eine überraschend grundlegende Designfrage. Sollen wir Roboter so bauen, dass sie in unserer menschlich gestalteten Welt funktionieren? Oder sollten wir Räume so umbauen, dass einfachere Maschinen genügen? Humanoid-Hersteller setzen auf die erste Option. Sie argumentieren: Unsere Welt ist für menschliche Körper gemacht – mit Treppen, Arbeitsflächen auf Schulterhöhe und „wichtigen Dingen“ auf Augenhöhe. Ein humanoider Körper scheint daher logisch, weil er theoretisch ohne Umbau in Küchen, Fluren und Waschküchen arbeiten könnte. Doch diese Vision konkurriert mit der Realität der bisher erfolgreichen Robotik. Denn heute funktionieren Roboter besonders gut dort, wo die Umgebung für sie optimiert ist. Das macht die Frage nicht technisch, sondern wirtschaftlich und gesellschaftlich: Was ist billiger, sicherer und schneller skalierbar – smarter Roboter oder smarter Raum?

Warum Lagerroboter heute gewinnen – und Humanoide kämpfen müssen

Die erfolgreichsten Roboter sind bislang meist nicht humanoid. Sie arbeiten in Warehouses, in denen Regalsysteme, Fahrwege und Sicherheitszonen auf sie zugeschnitten sind. Oft sind es einfache, rollende Picker, oder Bereiche sind strikt für Menschen gesperrt. Das reduziert Komplexität enorm. Ein zweibeiniger Roboter muss dagegen Gleichgewicht halten, Treppen bewältigen und mit „normalen“ Objekten umgehen, die nicht robotikfreundlich sind. Humanoide kämpfen deshalb bergauf, weil sie die schwierige Umgebung akzeptieren, statt sie zu vereinfachen. Dennoch glauben viele Firmen, dass genau hier der Durchbruch liegt. Ihre Wette: Wenn KI und Wahrnehmung gut genug werden, braucht man keine Spezialhallen mehr. Dann könnte ein Roboter in jeder Küche arbeiten, ohne dass Regale, Griffe und Wege neu gestaltet werden. Ob das realistisch ist, entscheidet sich an Details wie Greifen, Tempo, Sicherheit und Fehlertoleranz.

Sprache als Gamechanger – aber Halluzinationen als reales Risiko

Humanoid-Firmen setzen auf ein neues Werkzeug: KI-Systeme wie Googles Gemini und OpenAIs GPT, die menschliche Sprache verstehen. Das könnte die Bedienung radikal vereinfachen. Statt Programmierung würde ein Satz reichen: „Falte das Shirt“ oder „Räume das Geschirr weg“. Das klingt banal, ist aber ein großer Hebel für Akzeptanz, weil Nicht-Techniker Roboter nutzen könnten. Noch wichtiger: Solche Modelle könnten helfen, mit Situationen umzugehen, die nicht exakt trainiert wurden. Genau das ist ein klassisches Robotik-Problem: echte Welt ist voller Ausnahmen. Doch hier entsteht auch ein neues Risiko: Sprachmodelle können halluzinieren, also überzeugend falsche Informationen erzeugen. Bei einem Chatbot ist das nervig, aber meist ungefährlich. Bei einem Roboter kann eine falsch verstandene oder halluzinierte Anweisung zu Schäden oder Verletzungen führen. Damit wird „Verlässlichkeit“ plötzlich zur Sicherheitsfrage, nicht nur zur Komfortfrage.

Fazit

Die AI-Roboter kommen – doch die Welt ist nicht bereit, weil Alltag mehr ist als eine Demo. Solange Roboter langsam sind, bei weichen Objekten scheitern und Chaos kaum beherrschen, bleibt die große Haushalt-Revolution aus. Dazu kommt ein Vertrauensproblem: Menschen tolerieren Maschinenfehler weniger als menschliche Patzer. Und wenn Sprach-KI halluziniert, wird ein Irrtum plötzlich physisch gefährlich. Milliarden fließen trotzdem – und genau das macht die nächsten Jahre so spannend.

Der Autor Nico Nuss beschäftigt sich seit 2001 mit den Themen Mobile Computing und Automation Software. Auf Grund seiner Erfahrung und dem starken Interesse für Zukunftstechnologien gilt seine Aufmerksamkeit den Themen Robotik und AI.