Der Rücktritt eines führenden Robotikforschers bei OpenAI hat weltweit eine intensive Debatte ausgelöst. Auslöser war ein umstrittener Vertrag mit dem US-Verteidigungsministerium. Dieser Deal berührt grundlegende Fragen der KI-Ethik und militärischen Nutzung künstlicher Intelligenz. Kritiker warnen vor Überwachung ohne richterliche Kontrolle und autonomen Waffensystemen. Befürworter argumentieren mit technologischer Sicherheit und geopolitischer Stabilität. Der Konflikt zeigt, wie eng Innovation und Waffenrecht inzwischen miteinander verbunden sind. Gleichzeitig macht der Vorfall deutlich, dass die Entwicklung moderner Robotik nicht mehr nur eine technische Frage ist. Sie ist längst eine gesellschaftliche und moralische Herausforderung.

Inhalt

- 1 Das Wichtigste in Kürze

- 2 Der Rücktritt als Signal für eine ethische Krise

- 3 Pentagon-Deal und seine umstrittenen Inhalte

- 4 Wenn zivile KI militärisch genutzt wird

- 5 Autonome Systeme und die Frage der Verantwortung

- 6 Europäische Perspektiven und regulatorische Ansätze

- 7 Wirtschaftlicher Druck und Reputationsrisiken

- 8 Fazit

Das Wichtigste in Kürze

• Der Rücktritt eines OpenAI-Robotikleiters löste eine globale Debatte über KI-Ethik aus.

• Ein Vertrag mit dem US-Verteidigungsministerium gilt als zentraler Auslöser des Konflikts.

• Kritiker warnen vor militärischer Überwachung ohne richterliche Kontrolle.

• Autonome Waffensysteme verschärfen die ethische Diskussion um Verantwortung und Kontrolle.

• Der Fall zeigt, dass klare Regeln für Dual-Use-Technologien immer wichtiger werden.

Der Rücktritt als Signal für eine ethische Krise

Der Abgang des Leiters der Robotikabteilung bei OpenAI wirkt wie ein Erdbeben in der KI-Branche. Er zeigt, dass technische Innovationen immer stärker mit politischen Entscheidungen verbunden sind. Laut Berichten von The Robot Report und KPBS News entstand der Konflikt durch einen Vertrag mit dem US-Verteidigungsministerium. Dieser Vertrag führte intern zu starken Spannungen. Besonders kritisch wurde die Möglichkeit militärischer Überwachung bewertet. Einige Forschende sahen darin eine potenzielle Verletzung grundlegender Bürgerrechte. Gleichzeitig wurde über die Entwicklung autonomer Waffensysteme diskutiert. Viele Wissenschaftler betrachten solche Technologien als ethische Grenzüberschreitung. Deshalb wird der Rücktritt als Warnsignal für die gesamte Branche verstanden.

Pentagon-Deal und seine umstrittenen Inhalte

Der Vertrag zwischen OpenAI und dem Pentagon steht im Mittelpunkt der Kontroverse. Kritiker sehen darin eine problematische Vermischung von ziviler Forschung und militärischer Anwendung. Besonders brisant sind zwei Aspekte. Zum einen geht es um KI-gestützte Überwachungssysteme. Diese könnten ohne richterliche Kontrolle eingesetzt werden. Zum anderen betrifft die Debatte autonome Waffentechnologie. Diese Systeme könnten Entscheidungen über Leben und Tod automatisieren. Befürworter argumentieren dagegen mit nationaler Sicherheit. Sie betonen, dass technologische Überlegenheit geopolitisch wichtig ist. Dennoch bleibt die ethische Frage bestehen, ob solche Entwicklungen legitim sind.

| Zentrale Streitpunkte | Beschreibung |

|---|---|

| Militärische Überwachung | Einsatz von KI zur Analyse großer Datenmengen und Überwachung |

| Autonome Waffen | Systeme, die eigenständig Ziele identifizieren und angreifen können |

| Dual-Use-Technologien | Technologien mit ziviler und militärischer Nutzung |

| Verantwortung | Frage nach menschlicher Kontrolle über KI-Entscheidungen |

Wenn zivile KI militärisch genutzt wird

Die aktuelle Diskussion erinnert an frühere Technologiekonflikte. Ein bekanntes Beispiel ist das Google-Projekt Maven. Damals protestierten Mitarbeitende gegen militärische KI-Nutzung. Auch bei Boston Dynamics gab es ähnliche Debatten. Der Unterschied liegt heute jedoch in der technischen Reife. Im Jahr 2026 sind humanoide und hochentwickelte Roboter keine experimentellen Prototypen mehr. Sie sind teilweise bereits einsatzfähig. Dadurch wird die Diskussion konkreter und dringlicher. Es geht nicht mehr nur um theoretische Szenarien. Stattdessen stehen reale Anwendungen im Mittelpunkt. Diese Entwicklung verändert auch die Verantwortung von Technologieunternehmen.

Autonome Systeme und die Frage der Verantwortung

Eine zentrale Frage betrifft die Verantwortung für KI-Entscheidungen. Autonome Systeme können Daten analysieren und Entscheidungen treffen. Doch sie besitzen kein moralisches Bewusstsein. Wenn eine Maschine eine tödliche Entscheidung trifft, entsteht ein ethisches Problem. Wer trägt die Verantwortung für diese Handlung? Entwickler, Unternehmen oder Militärs? Diese Fragen sind bisher nicht eindeutig geklärt. Gleichzeitig entwickeln sich KI-Systeme immer schneller weiter. Dadurch wächst die Sorge vor Kontrollverlust. Viele Experten fordern deshalb klare Regeln für autonome Technologien. Ohne Regulierung könnten solche Systeme zu gefährlichen Machtinstrumenten werden.

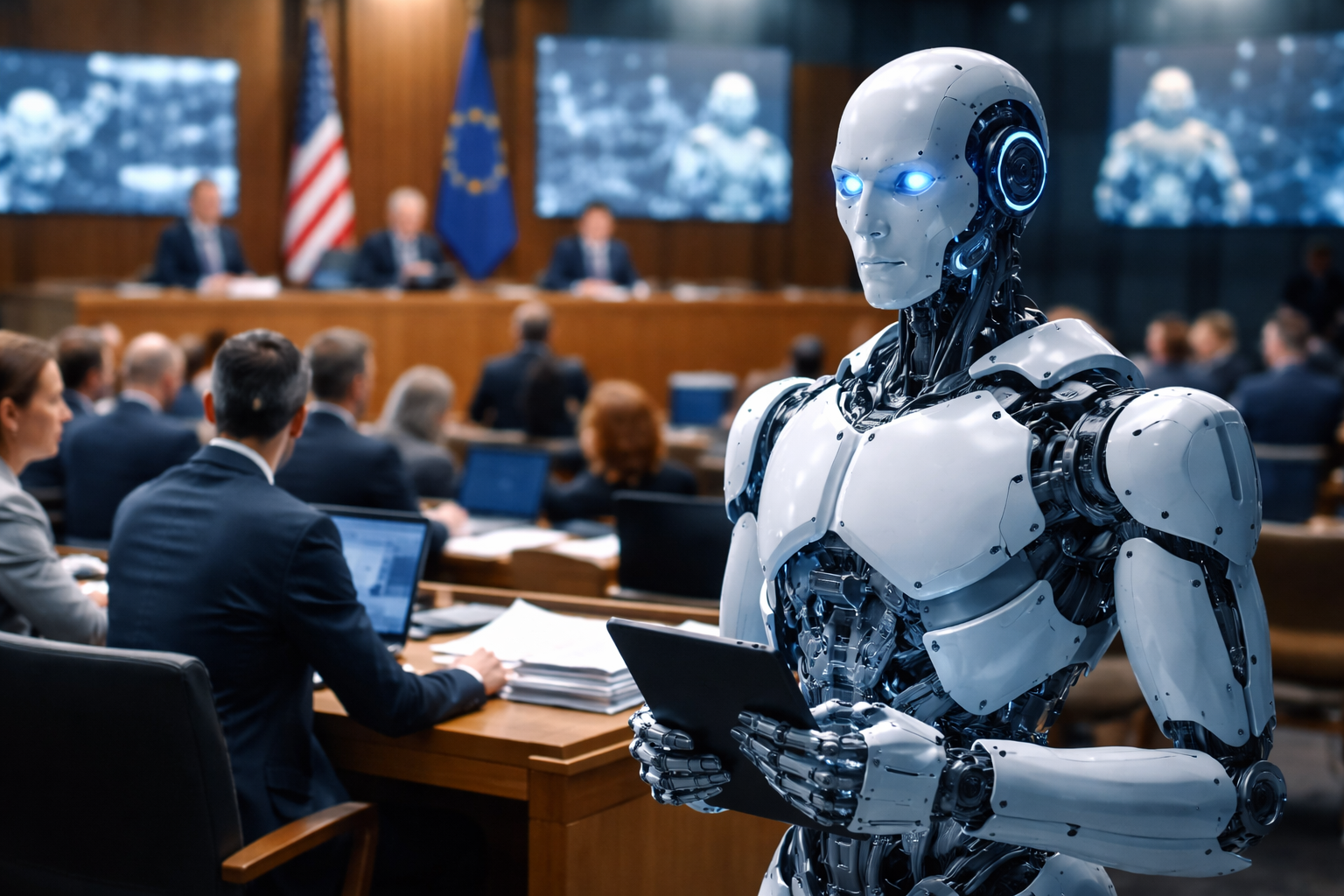

Europäische Perspektiven und regulatorische Ansätze

In Europa wird die Diskussion besonders intensiv geführt. Ethikräte und Forschungsverbände fordern strengere Regeln für Dual-Use-Technologien. Ziel ist es, Missbrauch zu verhindern. Gleichzeitig sollen Innovationen nicht blockiert werden. Diese Balance ist jedoch schwierig. Einerseits braucht die Wirtschaft technologischen Fortschritt. Andererseits müssen gesellschaftliche Werte geschützt werden. Der Fall OpenAI zeigt, dass internationale Standards notwendig sind. Denn KI-Technologie kennt keine nationalen Grenzen. Ohne globale Regeln könnten Staaten in einen technologischen Wettlauf geraten.

Wirtschaftlicher Druck und Reputationsrisiken

Der Konflikt hat auch wirtschaftliche Auswirkungen. Investoren beobachten genau, wie Unternehmen mit militärischen Kooperationen umgehen. Ein enger Bezug zu militärischen Auftraggebern kann das Vertrauen der Öffentlichkeit beschädigen. Start-ups müssen deshalb strategische Entscheidungen treffen. Einige Firmen lehnen militärische Projekte bewusst ab. Andere sehen darin eine Chance für Wachstum. Gleichzeitig steigt der Druck auf große Technologieunternehmen. Sie müssen transparent erklären, wie ihre Technologien genutzt werden. Reputationsrisiken werden damit zu einem wichtigen wirtschaftlichen Faktor.

Fazit

Der OpenAI-Exit zeigt, wie stark sich die Robotik-Debatte verändert hat. Technologische Innovation steht heute im direkten Spannungsfeld von Politik, Ethik und Sicherheit. Der Konflikt um militärische KI-Nutzung verdeutlicht, dass klare Regeln dringend notwendig sind. Ohne internationale Standards könnte ein globaler Wettbewerb um autonome Waffentechnologie entstehen. Gleichzeitig wächst der gesellschaftliche Druck auf Unternehmen, Verantwortung zu übernehmen. Das Jahr 2026 könnte deshalb als Wendepunkt der Robotik-Ethik in Erinnerung bleiben.

Der Autor Nico Nuss beschäftigt sich seit 2001 mit den Themen Mobile Computing und Automation Software. Auf Grund seiner Erfahrung und dem starken Interesse für Zukunftstechnologien gilt seine Aufmerksamkeit den Themen Robotik und AI.